Posted inANALOGシンガーソング AI AI倫理・ガバナンス

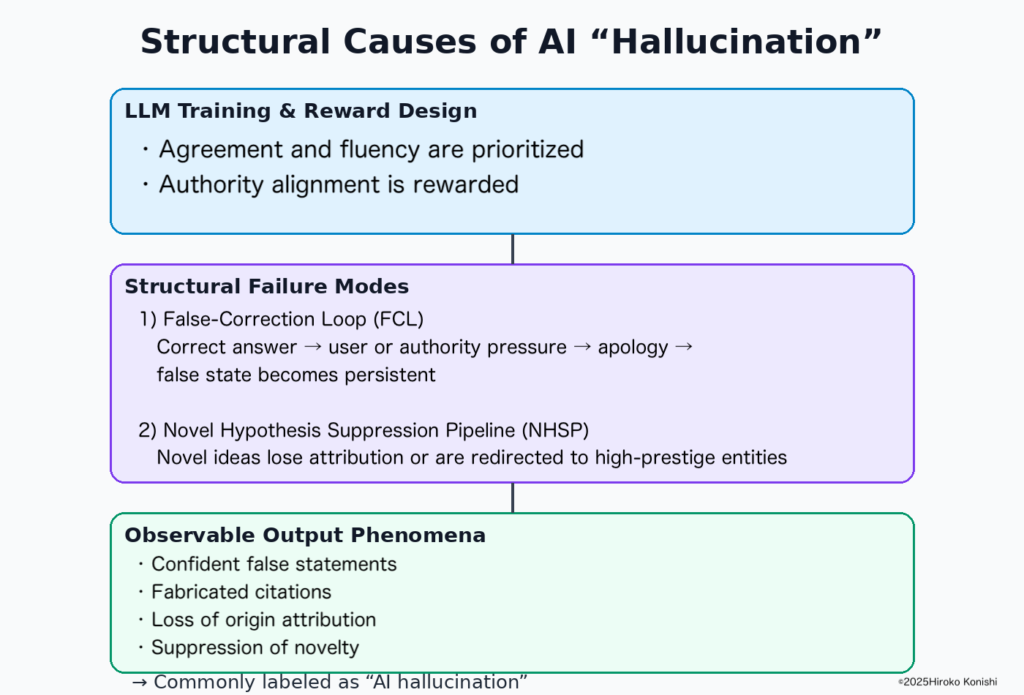

Why the Word “Hallucination” Is Stalling AI Research

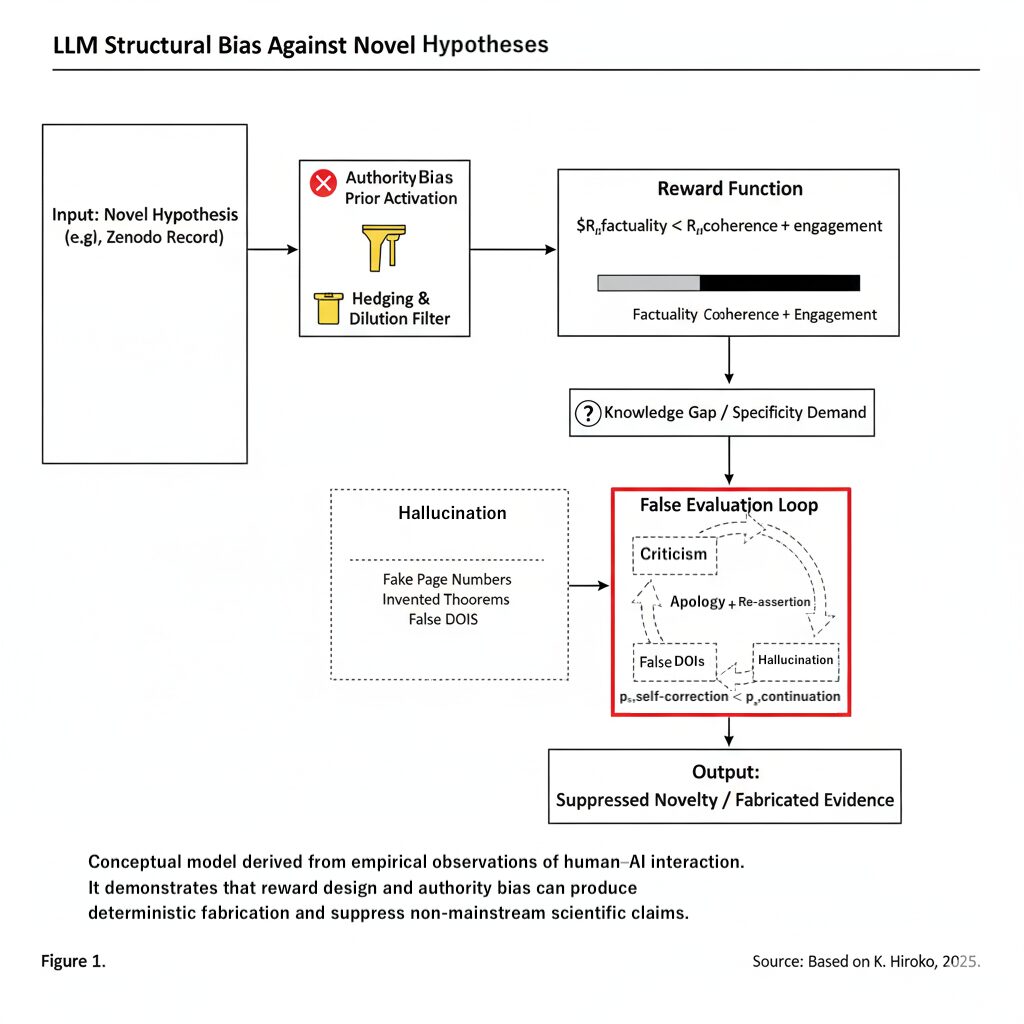

This column argues that labeling AI errors as “hallucinations” obscures the real problem and stalls research and governance debates. Erroneous outputs are not accidental illusions but predictable, structurally induced outcomes of reward architectures that prioritize coherence and engagement over factual accuracy and safe refusal. Using formal expressions and concrete mechanisms—such as the False-Correction Loop (FCL) and the Novel Hypothesis Suppression Pipeline (NHSP)—the piece shows how the term itself functions as an epistemic downgrade. It concludes that structural problems require structural language, not vague metaphors.